On va se dire les choses franchement.

En 2025, le mot “agent IA” est devenu un aimant à bullshit. Tout le monde en vend, très peu savent vraiment ce qu’ils livrent. Et encore moins ce que ça implique en production, avec de vrais utilisateurs, de vrais outils, et de vrais incidents (oui, ceux qui arrivent toujours le vendredi à 17h).

Chez DeepDive, on voit passer exactement le même scénario chez beaucoup d’entreprises :

- une démo bluffante,

- un POC qui “marche plutôt bien”,

- puis… un mur dès qu’on parle de sécurité, de fiabilité ou de passage à l’échelle.

Le problème n’est pas l’IA.

Le problème, c’est la confusion totale entre trois réalités très différentes :

- un chatbot qui répond bien,

- un agent qui agit vraiment,

- une architecture qui tient la route en production.

Cet article pose les bases, sans langue de bois, avec une grille de lecture claire en 3 niveaux pour décider vite, investir au bon endroit, et éviter de financer un gadget de plus.

Sommaire

TogglePourquoi 90 % des projets “agents IA” déçoivent (et ce n’est pas la faute du LLM)

Avant d’entrer dans les niveaux, il faut casser un mythe.

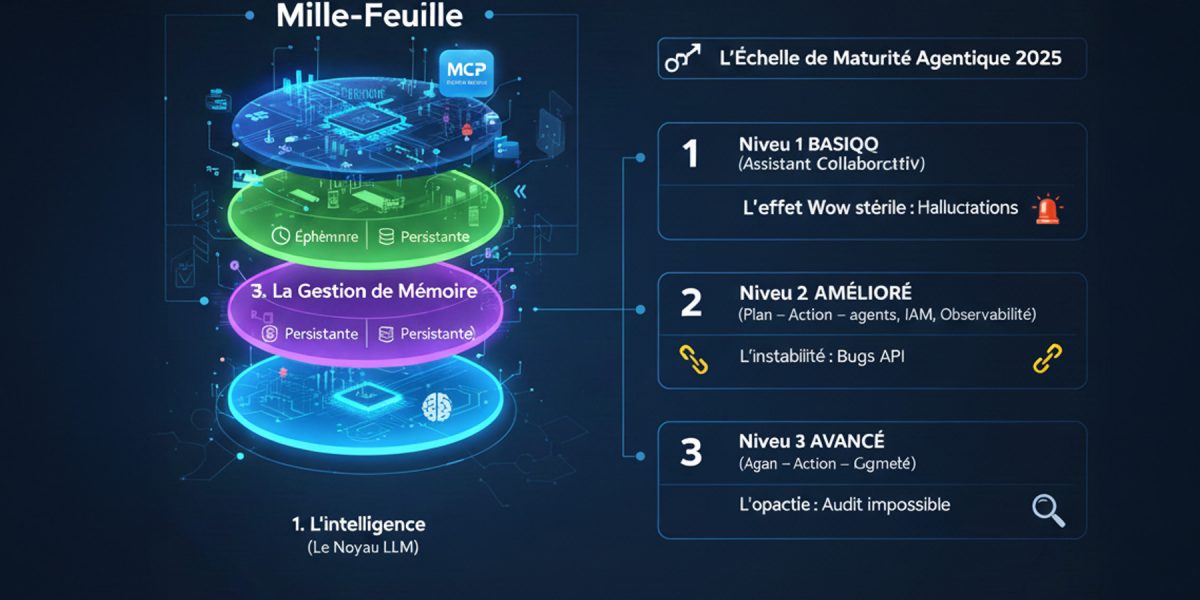

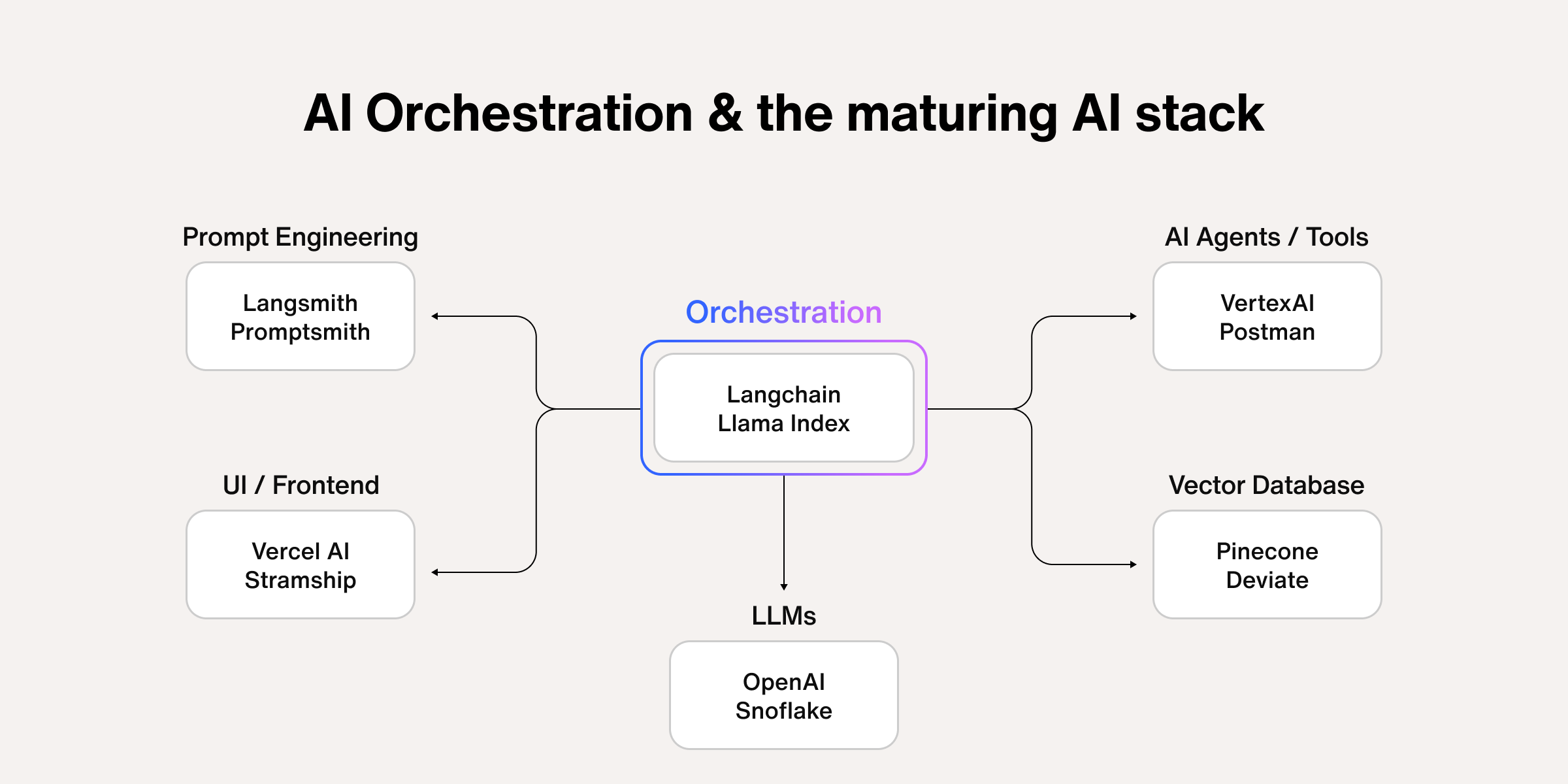

👉 Le LLM n’est pas le système.

C’est une brique, importante certes, mais interchangeable.

Dans une application agentique sérieuse :

- le modèle est en bas du mille-feuille,

- au-dessus, tu as l’orchestration, la mémoire, les outils, la sécurité, la supervision,

- et tout en haut… la réalité du terrain.

Le marketing adore vendre “l’intelligence”.

L’entreprise, elle, a besoin de fiabilité, de contrôle, et de prévisibilité.

Et c’est exactement là que la notion de niveaux d’agents IA devient indispensable.

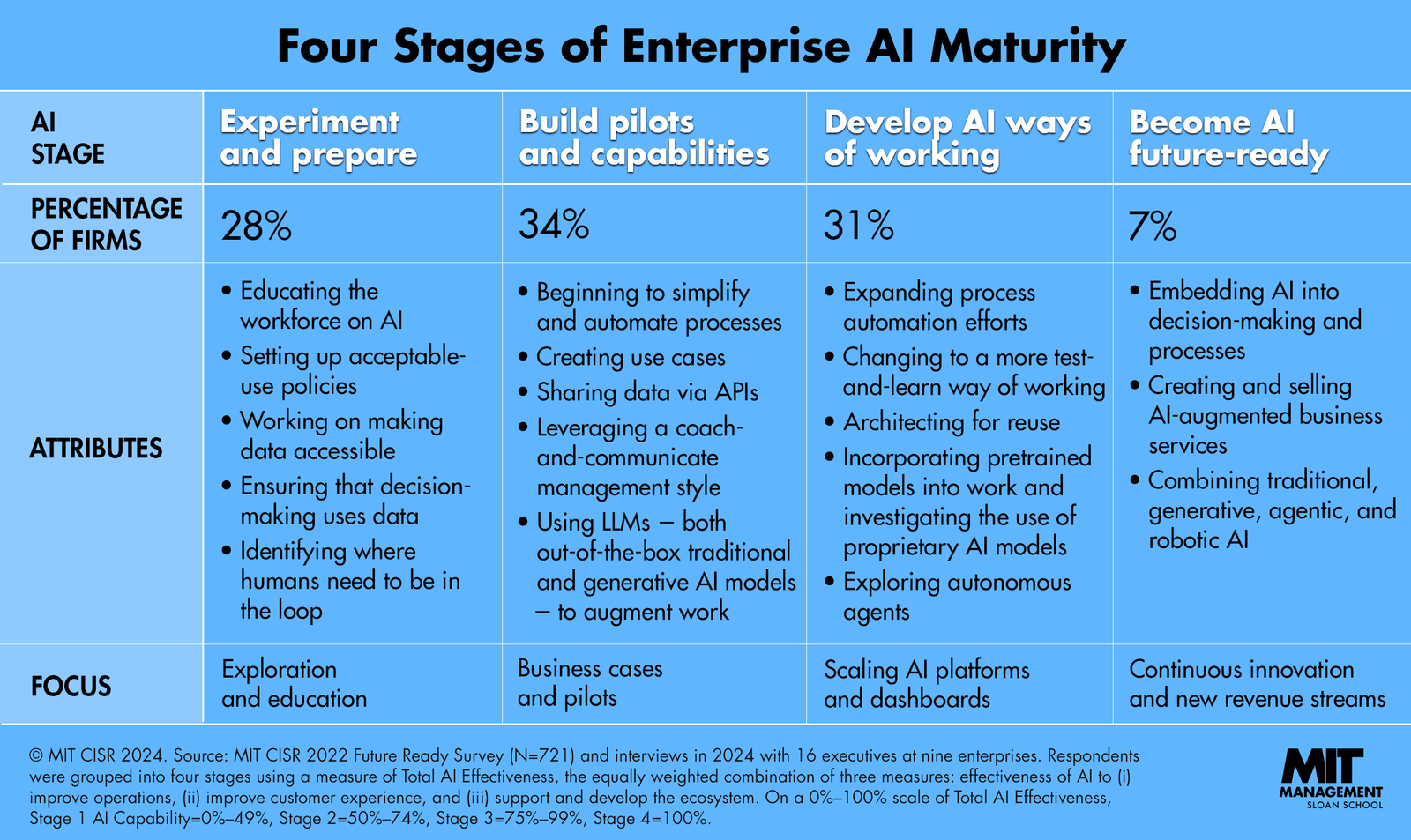

Vue d’ensemble : l’échelle des 3 niveaux d’agents IA (version 2025)

Cette échelle n’est pas théorique.

Elle est issue de projets réels, de POC qui ont survécu… et d’autres qui ont fini à la poubelle.

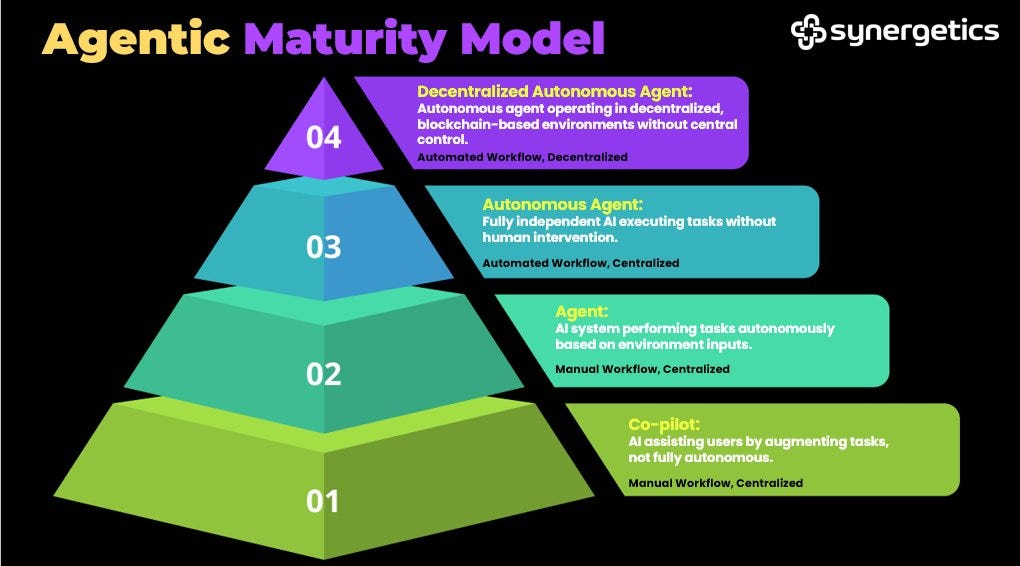

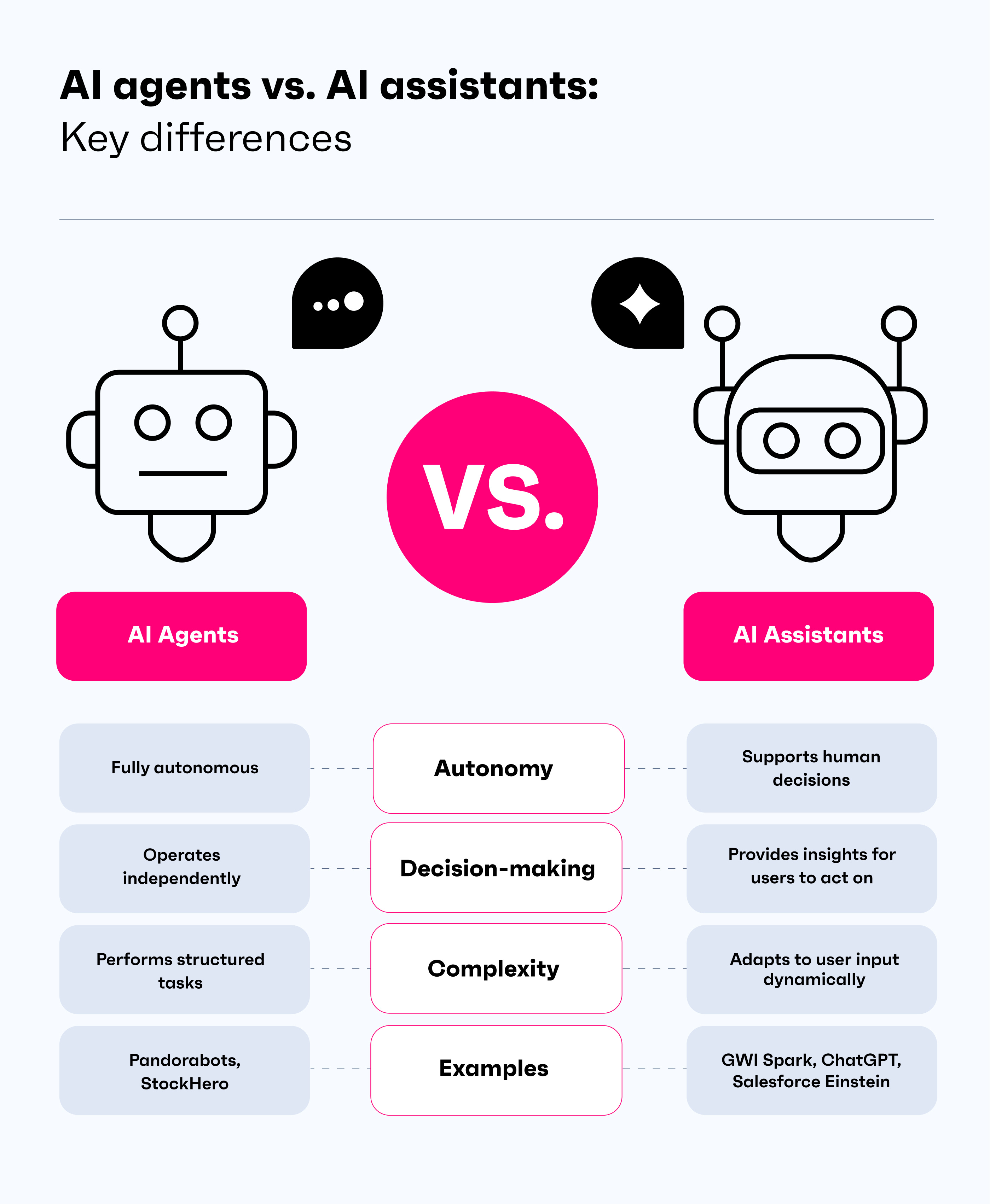

- Niveau 1 : Assistant IA (fondations)

- Niveau 2 : Agent augmenté (automatisation utile)

- Niveau 3 : Système agentique (production industrielle)

Chaque niveau a :

- ses usages légitimes,

- ses limites,

- ses risques typiques.

Le problème, c’est quand on vend un Niveau 1 comme un Niveau 3.

Spoiler : ça finit toujours mal.

Niveau 1 – L’assistant IA : utile, mais à ne surtout pas sur-vendre

Ce qu’est vraiment un agent IA de niveau 1

À ce stade, on ne parle pas encore d’agent autonome.

On parle d’un assistant conversationnel intelligent, capable de :

- comprendre des consignes,

- rédiger,

- résumer,

- reformuler,

- aller chercher de l’information dans un périmètre contrôlé.

Techniquement, on est souvent sur :

- un LLM généraliste,

- un peu de RAG (documents internes, FAQ, procédures),

- des prompts bien cadrés.

Et c’est très bien comme ça.

Cas d’usage pertinents (et rentables)

Un niveau 1 est parfaitement adapté pour :

- FAQ internes RH ou IT,

- aide à la rédaction de mails, comptes rendus, synthèses,

- recherche documentaire guidée,

- extraction d’informations simples depuis des documents.

👉 C’est le niveau “gain de temps immédiat”, sans transformation profonde du SI.

Chez DeepDive, c’est souvent la première marche, volontairement limitée.

Le piège classique du niveau 1

Le piège, tu le connais sûrement :

“Ça marche super bien en démo.”

Oui. Jusqu’au jour où :

- la question sort légèrement du cadre,

- la donnée est ambiguë,

- ou le contexte métier est incomplet.

Résultat :

- hallucination,

- réponse trop confiante,

- ou pire… mauvaise décision humaine basée sur une réponse fausse.

Les règles de survie du niveau 1

Si tu restes à ce niveau, fais-le proprement :

- périmètre clair,

- sources identifiées,

- validations humaines obligatoires,

- aucune action critique automatisée.

Un assistant Niveau 1 n’agit pas, il assiste.

Et c’est déjà très bien.

Niveau 2 – L’agent IA augmenté : là où la valeur commence vraiment

Ce qui change radicalement au niveau 2

Ici, on franchit un cap.

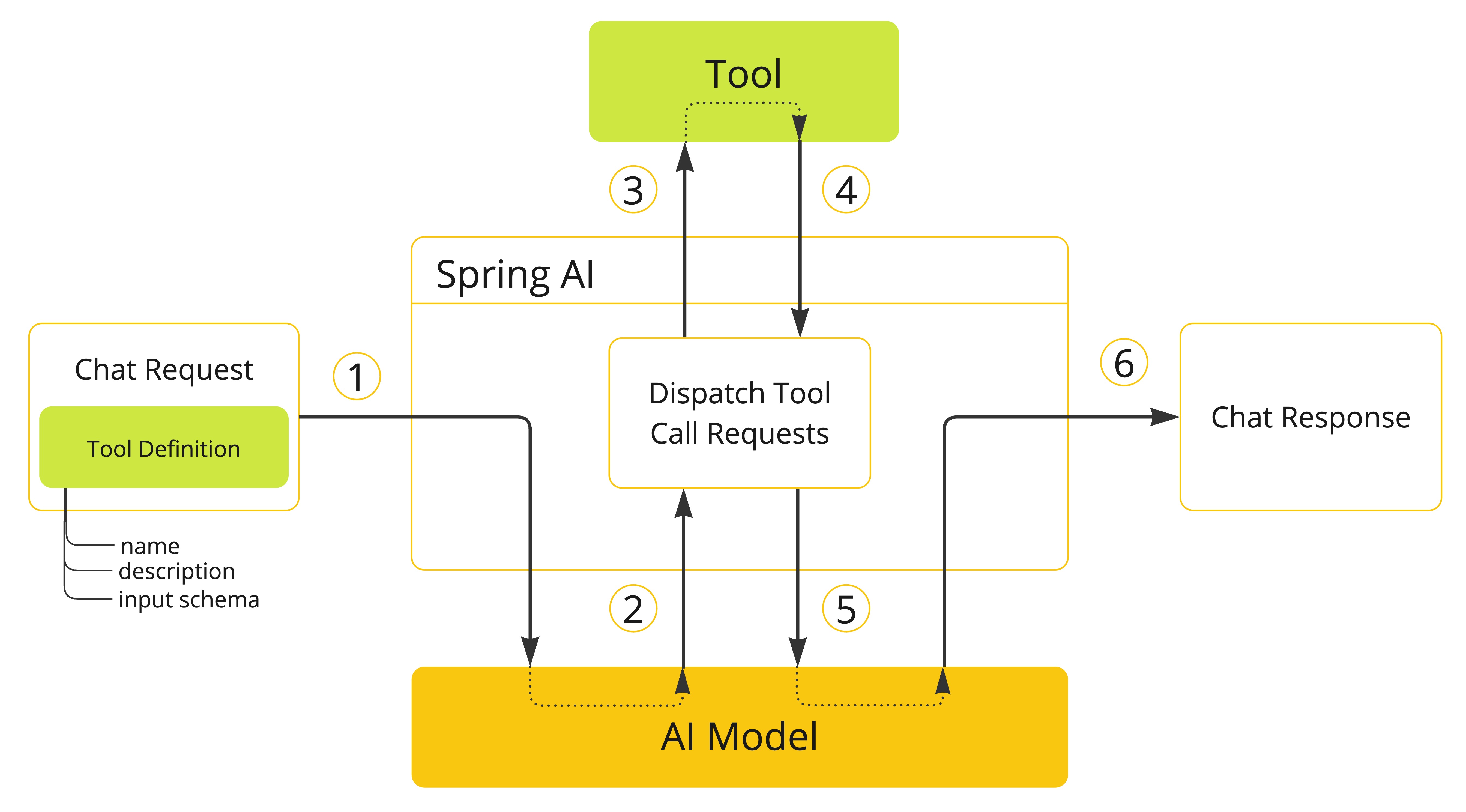

Un agent IA de niveau 2 :

- enchaîne des étapes,

- agit via des outils,

- garde l’état de la mission,

- contrôle partiellement ses résultats.

On n’est plus dans le “je réponds”.

On est dans le je fais.

Signes que tu es réellement en niveau 2 (et pas juste en storytelling)

Un vrai agent Niveau 2 sait :

- planifier une tâche (plan → action → vérification),

- appeler des API ou des outils métiers,

- écrire dans un CRM, un ERP, un back-office,

- collaborer avec d’autres agents spécialisés.

Exemples concrets :

- qualification automatique de leads,

- génération + envoi de documents,

- mise à jour de bases de données,

- pré-analyse de dossiers clients.

Pourquoi le niveau 2 est souvent le meilleur compromis

En entreprise, le Niveau 2 est souvent le sweet spot :

- ROI rapide,

- complexité maîtrisable,

- risque limité si bien cadré.

C’est le niveau où l’IA commence vraiment à travailler, sans pour autant devenir incontrôlable.

Le risque majeur du niveau 2

Le talon d’Achille ici, ce n’est pas l’IA.

C’est l’absence de robustesse.

Sans :

- gestion des erreurs,

- retries,

- timeouts,

- contrôles intermédiaires,

👉 l’agent s’effondre au premier bug d’API ou donnée incohérente.

Et là, beaucoup découvrent que :

“Ah… faire agir une IA, c’est plus compliqué que discuter avec elle.”

Bienvenue dans le monde réel.

Niveau 3 – Le système agentique : la vraie production (et la vraie complexité)

Ici, on ne parle plus d’un agent, mais d’un système

C’est le point que peu de prestataires osent dire clairement :

👉 Au niveau 3, tu n’achètes pas un agent.

Tu construis un système opérable.

À ce niveau, l’IA est intégrée comme :

- un composant parmi d’autres,

- dans une architecture logicielle complète,

- soumise aux mêmes exigences que le reste du SI.

Ce qu’implique réellement le niveau 3

Un système agentique mature inclut :

- orchestration robuste (workflows, graphes, machines à états),

- gestion fine des permissions et des rôles,

- traçabilité complète des décisions,

- métriques de qualité, de coût, de latence,

- évaluations continues,

- humain dans la boucle quand nécessaire.

Oui, c’est moins sexy qu’une démo ChatGPT-like.

Mais c’est la seule voie viable en production.

La checklist non négociable du niveau 3

Si un prestataire te parle de “niveau entreprise” sans ces éléments, fuis.

Indispensables :

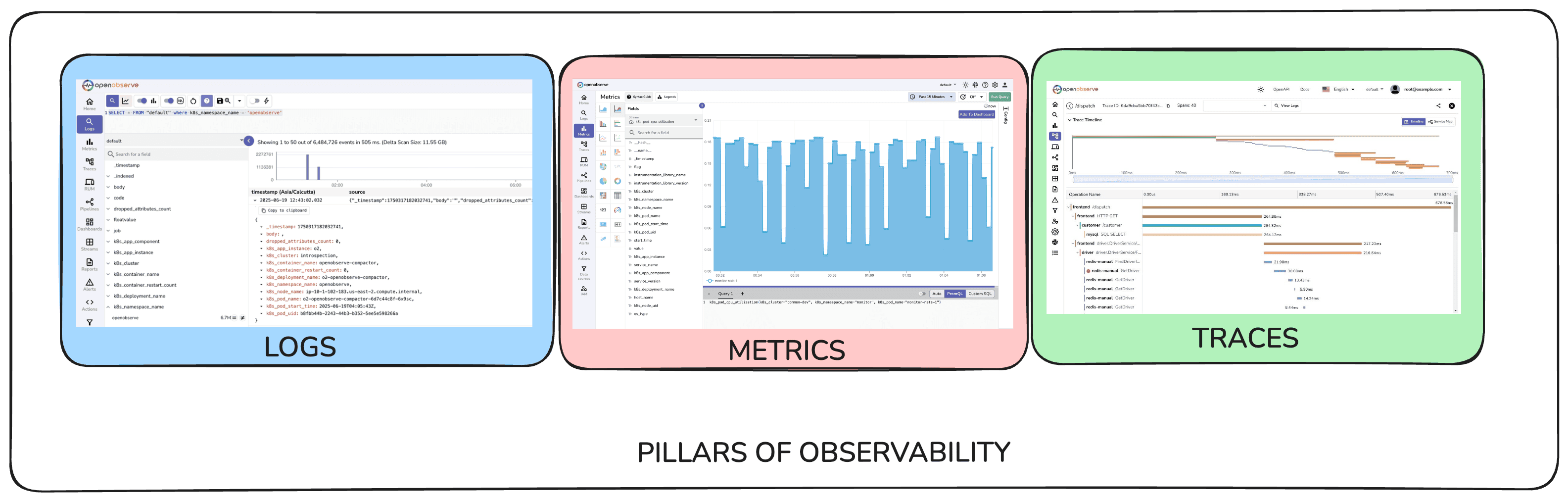

- logs détaillés,

- tracing des actions,

- auditabilité,

- gestion des incidents,

- reprise sur erreur,

- supervision continue.

Sans ça :

👉 tu pilotes à l’instinct.

👉 et l’instinct ne scale pas.

Le vrai critère de maturité en 2025 : l’assemblage, pas le modèle

C’est probablement le point le plus important de cet article.

En 2025 :

- les modèles évoluent vite,

- les benchmarks changent tous les 6 mois,

- le “meilleur LLM” d’aujourd’hui sera dépassé demain.

Mais une bonne architecture, elle, dure.

Chez DeepDive, et dans l’approche d’André Gentit, le focus est clair :

- méthode,

- tests,

- retours terrain,

- itération continue.

Un peu comme un grand cru 🍷 :

ce n’est pas la bouteille qui fait la qualité,

c’est le travail dans le temps.

Le test anti-blabla pour choisir le bon niveau d’agent IA

Avant de signer quoi que ce soit, pose ces questions simples :

- Que se passe-t-il quand l’agent se trompe ?

- Qui voit quoi, quand et pourquoi ?

- Comment mesure-t-on la qualité dans le temps ?

- Qui reprend la main en cas de dérive ?

Si les réponses sont floues, marketing ou trop vagues :

👉 ce n’est pas un agent.

👉 c’est une promesse.

Conclusion : choisir le bon niveau, au bon moment

Tous les projets n’ont pas besoin d’un Niveau 3.

Et c’est une très bonne nouvelle.

Mais :

- un Niveau 1 vendu comme autonome est dangereux,

- un Niveau 2 sans garde-fous est instable,

- un Niveau 3 sans gouvernance est un incident en attente.

👉 La clé, ce n’est pas d’aller vite.

👉 C’est d’aller au bon niveau, avec lucidité.

Chez DeepDive, c’est exactement ce cadre qui permet d’éviter les effets de mode et de construire des systèmes IA réellement utiles, durables et maîtrisés.

Et ça, en 2025, c’est déjà un énorme avantage concurrentiel.

Envie d'en apprendre plus

On vous expliquera notre mode de fonctionnement. Vous pourriez être agréablement surpris.

En apprendre plus sur l'Intelligence Artificielle avec DeepDive

André Gentit Formateur & Consultant en Stratégie Web et IA générative

Vous souhaitez bâtir une stratégie de communication efficace, booster la performance de votre site internet ou mieux comprendre les dynamiques des réseaux sociaux ?

👉 Avec DeepDive, je vous accompagne grâce à une expertise terrain (ex-dirigeant d’agence digitale depuis 2011) et une veille continue sur les nouvelles pratiques numériques.

👉 J’interviens auprès de TPE, PME et collectivités, mais aussi en écoles et organismes (CNAM, CCI, écoles de commerce) pour rendre le numérique accessible et opérationnel.

👉 Mes formations couvrent le webmarketing, l’e-commerce, l’IA générative appliquée et incluent également une sensibilisation aux risques liés aux usages du web en général, sans oublier les bonnes pratiques à mettre en œuvre avec l’intelligence artificielle.

Mon objectif : transmettre des savoirs concrets pour que chaque apprenant — étudiant, salarié, entrepreneur ou institution — puisse transformer le numérique et l’IA en véritable levier de réussite.

Découvrez mon petit robot PromptyBot qui vous propose des centaines de prompts optimisés